أثار توقيع شركة جوجل ديب مايند اتفاقية مع وزارة الدفاع الأمريكية (البنتاغون) لاستخدام تقنيات الذكاء الاصطناعي في عمليات سرية، موجة من الانتقادات الحادة داخل الشركة وخارجها. وأعرب موظف في جوجل ديب مايند عن “خجله الشديد” من العمل في الشركة بعد هذه الخطوة، مما سلط الضوء على الجدل المتزايد حول الاستخدام الأخلاقي لـ الذكاء الاصطناعي.

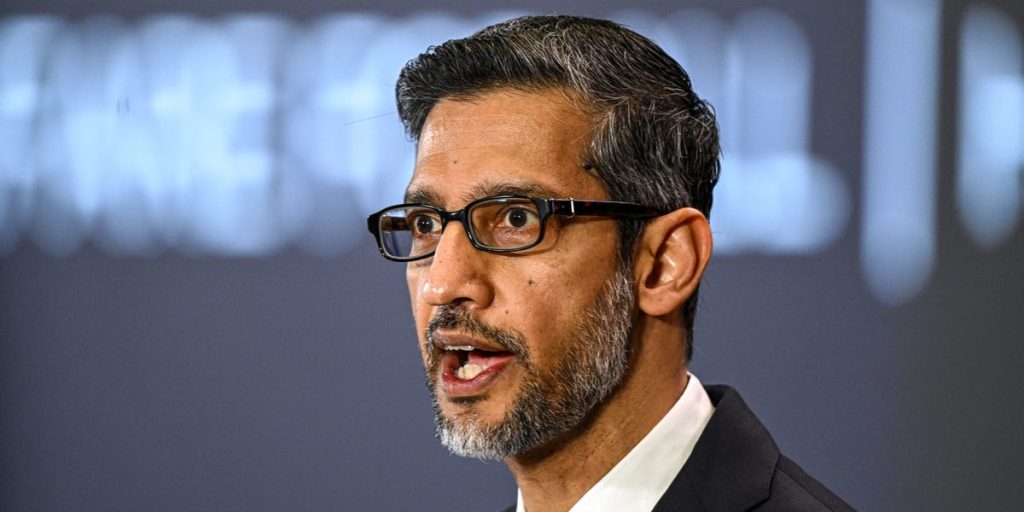

جاءت هذه الاتفاقية بعد تقرير نشره موقع “The Information” يوم الاثنين، كشف عن تفاصيل التعاون بين جوجل والبينتاغون في مشاريع تعتمد على الذكاء الاصطناعي مصنفة. وقد أرسل أكثر من 600 موظف في جوجل رسالة إلى الرئيس التنفيذي سوندار بيتشاي، يحثونه على منع البنتاغون من استخدام تقنيات الشركة في مثل هذه الأعمال.

جدل حول استخدام الذكاء الاصطناعي في العمليات العسكرية

أعرب أندرياس كيرش، عالم أبحاث في جوجل ديب مايند يعمل في مجال الذكاء الاصطناعي، عن صدمته من توقيع الاتفاقية. وكتب كيرش على منصة X (تويتر سابقًا) قائلاً: “لا أصدق أن جوجل قد وقعت اتفاقية لاستخدام نماذج الذكاء الاصطناعي الخاصة بنا في مهام سرية. هذا أمر مخزٍ بكل صراحة.” وأضاف في تصريحات لـ Business Insider أنه كان يأمل أن تؤثر رسالة الموظفين على القرار، لكنه استيقظ ليجد أن الاتفاقية قد تم توقيعها بالفعل.

أكد متحدث باسم جوجل أن الاتفاقية هي تعديل على عقد قائم، وأن الشركة قد وقعت بالفعل اتفاقية مع البنتاغون في أواخر العام الماضي لاستخدام الذكاء الاصطناعي في أعمال غير مصنفة. وأضاف المتحدث أن جوجل تدعم الوكالات الحكومية في مشاريع مصنفة وغير مصنفة، وتطبق خبراتها في مجالات مثل الخدمات اللوجستية والأمن السيبراني والترجمة الدبلوماسية وصيانة الأسطول والدفاع عن البنية التحتية الحيوية.

مخاوف بشأن الأسلحة المستقلة والمراقبة الجماعية

أعرب الموظفون في رسالتهم إلى بيتشاي عن قلقهم بشأن استخدام الذكاء الاصطناعي في مجالات مثل الأسلحة المستقلة القاتلة والمراقبة الجماعية. وأشاروا إلى أن هذه الأنظمة يمكن أن تتركز السلطة في أيدي قلة، وأنها عرضة للأخطاء. وأكدوا على مسؤوليتهم كباحثين في مجال الذكاء الاصطناعي لمنع الاستخدامات غير الأخلاقية والخطيرة لهذه التقنيات.

في العام الماضي، قامت جوجل بتحديث مبادئها الخاصة بالذكاء الاصطناعي لإزالة التعهد بعدم استخدام الذكاء الاصطناعي في الأسلحة أو المراقبة. وأبلغ مسؤولو جوجل ديب مايند الموظفين في اجتماع في يناير الماضي أنهم يجب أن يتوقعوا المزيد من الصفقات الدفاعية في المستقبل. ويرى كيرش أن إزالة هذه التعهدات كان من المفترض أن تسمح بمزيد من الاعتبارات الدقيقة، لكنه لا يرى أي دقة في السماح بأي استخدام قانوني للذكاء الاصطناعي، بما في ذلك الأسلحة المستقلة والمراقبة الجماعية.

أشار كيرش في منشور له على X إلى اتفاقية مماثلة بين OpenAI والبينتاغون لأنظمة سرية. وتساءل عن سبب توقيع جوجل على عقد أضعف بعد التدقيق الذي تعرضت له صفقة OpenAI، وعبر عن قلقه من أن هذا قد يُنظر إليه على أنه تعامل قصير النظر وجشع يفقد الثقة.

تأتي هذه التطورات في ظل نقاش عالمي متزايد حول أخلاقيات الذكاء الاصطناعي وضرورة وضع ضوابط تنظيمية للاستخدامات العسكرية لهذه التقنية. وتثير هذه القضية تساؤلات حول دور شركات التكنولوجيا في تطوير ونشر تقنيات قد يكون لها آثار عميقة على الأمن والسلامة العالمية. كما أنها تسلط الضوء على أهمية الشفافية والمساءلة في تطوير تطبيقات الذكاء الاصطناعي.

بالإضافة إلى ذلك، يراقب الخبراء عن كثب التطورات المتعلقة بـ الذكاء الاصطناعي الدفاعي، حيث تتسارع وتيرة البحث والتطوير في هذا المجال. ومن المتوقع أن تشهد الأشهر القادمة المزيد من المناقشات حول كيفية تنظيم استخدام الذكاء الاصطناعي في العمليات العسكرية، وما هي الضمانات اللازمة لمنع الاستخدامات غير الأخلاقية أو الخطيرة.

من المرجح أن تستمر هذه القضية في إثارة الجدل والنقاش داخل جوجل وخارجها، وقد تؤدي إلى مزيد من الضغط على الشركة لإعادة النظر في سياساتها المتعلقة بالتعاون مع البنتاغون. ومن المتوقع أن يصدر المزيد من البيانات والتحليلات حول هذه القضية في الأسابيع القادمة، مما قد يؤثر على مستقبل تطوير ونشر تقنيات الذكاء الاصطناعي.